Künstliche Intelligenz – agile Thesen (Teil 1): Aktuelle Möglichkeiten und Grenzen der KI

Man kann der digitalen Transformation mit unterschiedlichen Haltungen begegnen: schicksalsergeben („das müssen wir jetzt über uns ergehen lassen“), anpasserisch („wir machen mit, was das Land von uns verlangt“), aktiv („das ist eine Chance, die wollen wir für uns nutzbar machen“), ignorierend („ich habe für so Nebenthemen keine Zeit, ich muss meine Wahl sichern und mich um die Flüchtlingsflut kümmern“). Welche Haltung man wählt, hängt sicher zum Teil von persönlichen Neigungen ab. Aber ein paar Sachkenntnisse können auch nicht schaden. Deswegen möchten wir gerne mit euch, liebe Leser, einen Blick auf einen wichtigen Teilaspekt richten: Was kann eigentlich die Künstliche Intelligenz? Und was soll sie können dürfen?

Das Thema verunsichert viele. Angesichts von in den Medien beschworenen Perspektiven, dass künstliche Gehirne bald unser menschliches überflügeln könnten,

wird unsere Identität als Spezies bedroht. Bist du, lieber Leser, dir deiner selbst sicher? Kann es nicht sein, dass du ein Bot bist? Mach den Captcha-Test: Welche Zahl verbirgt sich im nebenstehenden Bild?

Solltest du die Zahl nicht auf Anhieb erkennen können, ist leider der unwiderlegbare Beweis erbracht, dass du ein Roboter bist. Bitte lies in diesem Fall nicht weiter – der Text ist nicht für dich bestimmt.

KI ist Mustererkennung

Womit wir beim Thema wären: Das Gebiet, auf dem die Künstliche Intelligenz rasante Fortschritte macht, ist die Fähigkeit von Maschinen, Muster zu erkennen. In einem Artikel „Hysterie und Hype um KI“ /1/ schrieb Nicola Jentzsch kürzlich:

Derzeit mutet die öffentliche Debatte um Künstliche Intelligenz (KI) hysterisch an. Maschinen werden schlauer als Menschen, handeln eigenständig, zerstören Arbeitsplätze und Gesellschaften. Diese Hysterie lädt zu einem Gedankenspiel ein: Was wäre, wenn wir den Begriff „Künstliche Intelligenz“ durch „Mustererkennung“ ersetzten?

Schließlich sind viele der heute eingesetzten Verfahren des maschinellen Lernens genau dies: Mustererkennung in der Ton-, Text- und Bildverarbeitung. Dann würden schillernde Sätze wie jene, dass KI die digitale Schlüsseltechnologie schlechthin sei, (Achim Berg, Bitkom-Präsident) zu „Mustererkennung ist die digitale Schlüsseltechnologie schlechthin.“ Und Deutschland müsste dann möglichst rasch eine „Strategie für Mustererkennung“ erarbeiten, um im Wettbewerb um „Mustererkennung“ ganz vorne mit dabei zu sein.

Was bedeutet „Mustererkennung“?

Mustererkennung beruht auf der Vorstellung, dass man mit statistischen Verfahren Muster in verschiedenen Datenbeständen a) identifizieren und b) miteinander in Beziehung setzen (korrelieren) kann.

Beispiel 1: Medizinische Diagnosen

Nehmen wir an, wir verfügten über eine riesige Datenbank mit Krankheitssymptomen von Menschen. Diese sind verknüpft mit den dazugehörigen Diagnosen. KI-Methoden können aus der Symptomdatenbank Muster von Symptom-Kombinationen herausfiltern. Wenn ich als Arzt einen Patient mit einem Symptom-Komplex vor mir habe, dann kann ich in der Datenbank nach diesem Komplexmuster suchen, und das Diagnose-Programm liefert mir die oder mehrere mögliche Diagnosen. Es stellt vielleicht zusätzliche Fragen nach Symptomen, um eine Differentialdiagnostik zu ermöglichen.

Der gigantische Vorteil davon ist, dass auch seltene Symptomkombinationen gefunden werden können. Wenn eine seltene Krankheit nur einmal unter 1 Million Patienten auftritt, hat ein einzelner Arzt fast keine Chance, jemals bei einem Patienten die entsprechenden Symptome beobachtet zu haben. Sein Berufsleben ist zu kurz, um diese Erfahrungen zu sammeln. Eine Datenbank, die auf den Diagnosen von z. B. 100 Millionen Menschen beruht, würde ihm erlauben, diese Beschränkungen seiner individuell begrenzten Existenz und Lebenserfahrung zu sprengen.

Beispiel 2: Sprachübersetzer

Google hat einen Übersetzungsassistenten. In diesen kann man einen Text aus einer Fremdsprache eingeben und z. B. ins Deutsche übersetzen lassen (oder umgekehrt). Die Ergebnisse sind mittelmäßig. Bei einfachen Texten sind sie recht gut, sie bedürfen aber immer der interpretierenden Überprüfung. Ich erinnere mich noch an meine erste Erfahrung mit dem Google-Assistenten. Mein Portugiesisch ist ziemlich rudimentär. Ich verstand den Text eines Fado von Amàlia Rodrigues nicht („Vou Dar de Beber À Dor“) und gab ihn Google zum Übersetzen. Das Deutsch, das Google mir anbot, verstand ich noch weniger als den portugiesischen Text. Aus poetischen Blumen war wildes Wortunkraut geworden.

Denn auch das Übersetzen von Sprachen versucht Google mit Mustererkennung zu lösen: es verfügt über eine riesige Datenbank mit portugiesischen Texten und deren (von Menschen vorgenommenen!) deutschen Übersetzungen. Der KI-Interpreter versucht jetzt gar nicht, irgendwelche grammatischen Konstruktionen im portugiesischen Text zu entschlüsseln und „sinngemäß“ in passende deutsche Sprachstrukturen zu übertragen. Er bleibt auf der Ebene von Textstrings, die er mechanisch matcht. Mechanisch auf höchstem Niveau! Mit neuronalen Netzen! Sich immer weiter verbessernd! Aber eben – mechanisch, ohne jegliche Kenntnis grammatikalischer Regeln, ohne jegliche Kenntnis der wirklichen Welt.

KI bedarf des Menschen

Die KI-Strategien der Mustererkennung beruhen immer auf Ergebnissen menschlicher Tätigkeit. Die Diagnosen der medizinischen Datenbank müssen verifiziert sein – wenn Fehldiagnosen nicht rausgefiltert werden, ist die Sammlung wertlos. Die Übersetzungen, auf die der Sprachalgorithmus zugreift, müssen ebenfalls von Muttersprachlern gecheckt worden sein.

Das Schlimmste sind Rückkopplungen. Wenn die Ergebnisse der Google-Übersetzungen wieder in die Datenbank eingespeist würden, würde in kürzester Zeit ihre Qualität ins Bodenlose sinken. Beispiele dafür gibt es bereits. /2/

Was KI (bis jetzt) nicht kann

Was ist der Unterschied zwischen „Intelligenz im Allgemeinen“ und „Mustererkennung“ im Besonderen? Hören wir dazu die Meinung von David Ferrucci an. Ferrucci ist Chefingenieur des Watson-Projekts von IBM. Watson wiederum ist derzeit eine der fortgeschrittensten KI-Produkte – eine der früheren Versionen besiegte 1997 den Schachweltmeister Garri Kasparow; in 2011 die Jeopardy!-Meister Ken Jennings und Brad Rutter; und mittlerweile hat er sogar Meisterspieler im Go besiegt, dem komplexesten strategischen Brettspiel. Die Watson-Maschine wird derzeit lt. IBM-Angaben weltweit blendend verkauft, z. B. für Anwendungen in Call-Centern.

Ferrucci spricht in einem Interview auch davon, dass die Fortschritte Watsons auf Mustererkennung beruhen, aber diese Technik sie niemals zu intelligenten Einschätzungen einer Situation (eines „Kontextes“) befähigt. (Was nicht ausschließt, dass das auch irgendwann mal der Fall sein wird. Aber die gegenwärtige Technologie zielt darauf nicht ab.) Den Unterschied, so Ferrucci, könne man an zwei Fragen klarmachen.

Frage 1: „Welche zwei russischen Politiker haben in den vergangenen 20 Jahren die Ämter getauscht?“ Antwort: Putin und Medjedew. Diese Frage kann mit Mustererkennung gelöst werden. Sie bezieht sich auf eine historische Tatsache und kann mittels sehr komplexen lernenden Algorithmen letztlich auf eine Suche in Tabellen zurückgeführt werden. Das ist Big Data-Technik.

Frage 2: „Werden in den kommenden 10 Jahren zwei russische Politiker die Ämter tauschen?“ Dafür gibt es keine richtige Antwort, sondern nur Wahrscheinlichkeitseinschätzungen. Man kann nirgendwo nachschlagen. Man muss eine intelligente Einschätzung der Absichten von Putin, des Charakters von Medjedew und von Kausalzusammenhängen in der russischen Politik vornehmen. Das ist ein Urteil, das auf einer Vorstellung von Sinn beruht. Das kann derzeit nur der Mensch. /3/

Es ist übrigens typisch, dass die KI-Experten selbst (und Ferrucci ist einer der weltbesten unter ihnen) die Erwartungen in die neue Technik deutlich gedämpfter sehen als Menschen, die damit Geschäfte oder – fast noch schlimmer – Politik machen wollen. Ein gutes weiteres Beispiel dafür ist Joseph Weizenbaum (1923-2008), der 1966 das Programm ELIZA entwickelte – ein erster Prototyp der Erkennung natürlicher Sprache durch einen Computeralgorithmus und Vorläufer moderner Chatbots. Weizenbaum zeigte sich entsetzt, welche übersteigerten Erwartungen in der Öffentlichkeit durch dieses relativ einfache Programm geweckt wurden. Er veröffentlichte mehrere Bücher und trat öffentlich auf, weil er in diesen Erwartungen einen technischen Mystizismus sah, der die eigentliche Gefahr in der KI-Anwendung darstelle. /4/

TrotZ allem: Die künstliche Intelligenz ist eine Chance

Zwei Bedingungen müssen erfüllt sein, damit KI gut funktioniert:

- Der Mensch, der mit einem entsprechenden Algorithmus arbeitet, muss eine Vorstellung davon haben, wie KI funktioniert. Dann kann er nämlich

- fehlerhafte Ergebnisse, die der KI-Bot vorschlägt, erkennen und sinnvoll interpretieren und korrigieren, ohne den Algorithmus gleich in Grund und Boden zu verdammen.

„Computer besiegt Go-Meister“, lautete eine Schlagzeile – wobei Go das komplexeste strategische Brettspiel ist – viel komplexer als Schach. Die Meldung erregte Aufsehen und erschreckte auch. Ein Ergebnis ein paar Wochen später dagegen fand kaum Beachtung: ein Computerprogramm, das im Verein mit einem Menschen spielt, schlägt jeden anderen Computer. Das ist die Zukunft – unkünstliche Intelligenz, die künstliche Intelligenz vorurteilslos nutzt.

Anmerkungen

/1/ Nicola Jentzsch: „Künstliche Intelligenz Hysterie und Hype um KI. Künstliche Intelligenz wird derzeit überschätzt. Man sollte lieber von Mustererkennung sprechen.“, in: Frankfurter Rundschau, 26. Juni 2018

/2/ Vgl. den Artikel „Künstliche Intelligenz: Experiment beendet, weil Bots eigene Sprache entwickelten. Forscher bekamen Verständnisprobleme“ in: Der Standard, Österreich, Artikel vom 01.08.2017

/3/ Zitiert nach: Philip E. Telock, Dan Gardner: „Superforecasting. Die Kunst der richtigen Prognose“, S. Fischer Verlag, 2016, Seiten 30-32.

/4/ : „Die Macht der Computer und die Ohnmacht der Vernunft“, suhrkamp taschenbuch wissenschaft, Band 274, 1978

Lieber Wolf,

ich bekam gerade an meinem Post auf Facebook einen sehr interessanten Hinweis darauf, dass bei der ganzen Diskussion um die Intelligenz von Maschinen sehr schon zu sehen sei, dass wir in einer durch und durch materialisierten Denkwelt festsäßen. Die spirituelle Komponenten von Geist und Seele würde gar nicht mehr berücksichtigt. Hier steht das, was Mensch mit Intuition und Empathie beschreibt. Das, was z.B. Vertreter wie Shaldrake über morphische Felder forschen, zu dem Menschen Zugang haben, aber eben keine mechanische Maschine …

Danke für diese interessanten Denkanstöße

Martin

Es gibt auf dem News Portal ‚Neue Debatte – Journalkismus und Wissenschaft von unten‘ eine interessante Artikelserie zum Thema, nur dass hier die Automatisierung als Begriff im Vordergrund steht, und was es mit den Menschen in einer definierten Gemeinschaft macht:

Fundstelle: Die Automatisierung und ihre Auswirkungen auf die Gesellschaft

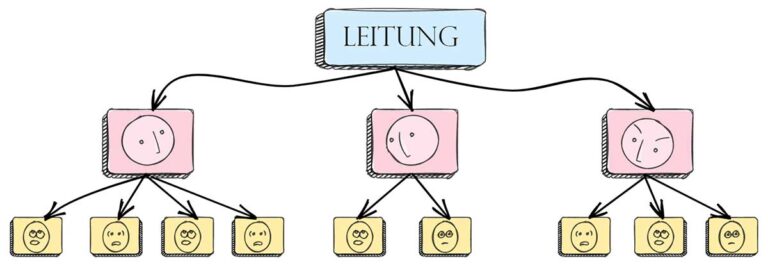

Ich muss mich nochmals melden, denn ich bekomme zum Thema ‚Agile Verwaltung‘ auf Facebook immer wieder mal harsche Kritik in den Kommentare zu Artikeln unseres Blogs. Gerne möche die folgende Kritik mal zur Diskussion hier einstellen:

Wenn hier von System gesprochen wird, dann ist hier weniger der politische Überbau gemeint sondern allein die Grundregel gemeint: grenzenloser Besitz an Ressourcen und ein Geldsystem, das in sich den Effekt trägt, dass das Haben konituierliche immer schneller von den Armen zu den Reichen fließt. Insofern könnte man auf die Idee kommen, dass das agile miteinander Arbeiten am Ende das Geld noch viel schneller so umverteilt, weil der Prozesse effikter und mit viel mehr Freude ausgeführt wird, nur dass 95% der Bürger nicht wissen, was den Effekt der Umverteilung bewirkt.

Ich bin allerdings der Meinung, dass das Unwisssen nicht dramatisch ist. Wir haben hier im Blog immer wieder darauf aufmerksam gemacht, dass agil etwas mit Haltung zu tun hat. Diese Haltung meint, sich gegenseitig auf Augenhöhe und mit Respekt zu begegenen. Und wenn dieser Haltungskeim sich an der Graswurzel ausweitet, weil die, die das Arbeiten auf diese Weise kennengelernt haben, auf andere ansteckend wirken, dann wird sich dieses ‚System‘ von ganz alleine umstellen. Ich verwende dazu gerne das Bild des Wandels von der Raupe zum Schmetterling. In der Raupe gibt es irgendwann die ersten Keime des neuen Lebens. Und wenn diese genügend sind, verpuppt sich die Raupe. Und wenn der Wandel abgeschlossen ist, kommt der schöne Schmetterling aus dem Coucon …